目次

ChatGPTのAPIを一般公開してから約2週間、3月14日(現地時間)にOpenAIはGPT-3.5の進化版であるGPT-4を発表しました。

忙しいそこのあなたのために、今までと何が違うのか短く要点をまとめると…

⦁ 画像をプロンプトとして入力できるようになった※←New!

⦁ かなり複雑なタスクにも対応ができるようになった

⦁ 各言語能力が大幅に向上した

⦁ 以前の約3倍の情報量の処理が可能になった(最大25,000単語の出力)

⦁ 回答の精度・安全性が上がった

です!

Gpt-4では、既存の機能のアップグレードがメインで、新規に追加されたのは画像プロンプト入力のみ、という事になります。要点で簡潔にまとめてしまうと「なんだそれだけか」という印象を受けるかもしれませんが、今回のアップデートはとにかくすごいんです!

※現段階では一般ユーザーは使えないようです

何がどうすごいのか、さらに詳しく知りたい方のために以下でそれぞれの要点やGPT-4を使ったサービスについて説明をしていきます。

「そもそもChatGPTって何?」という方は、こちらの記事で詳しく説明していますので、是非ご参照ください。↓

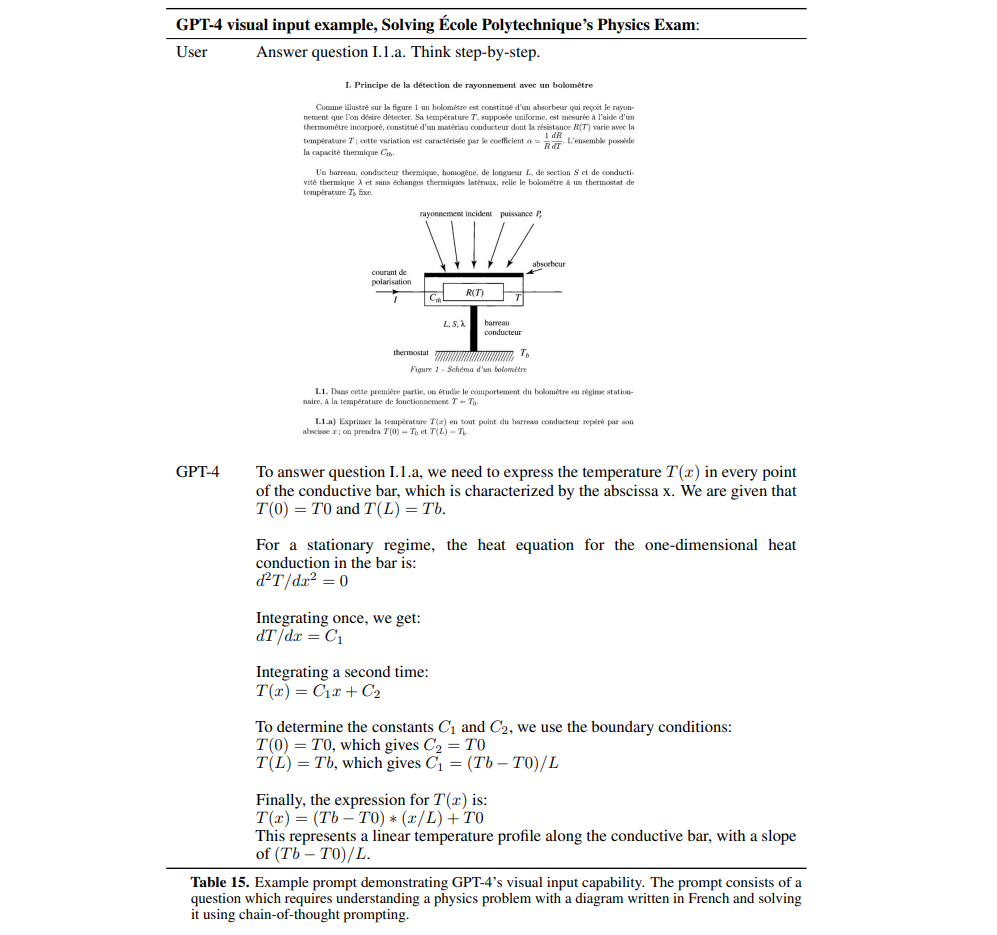

画像をプロンプトとして入力できるようになった

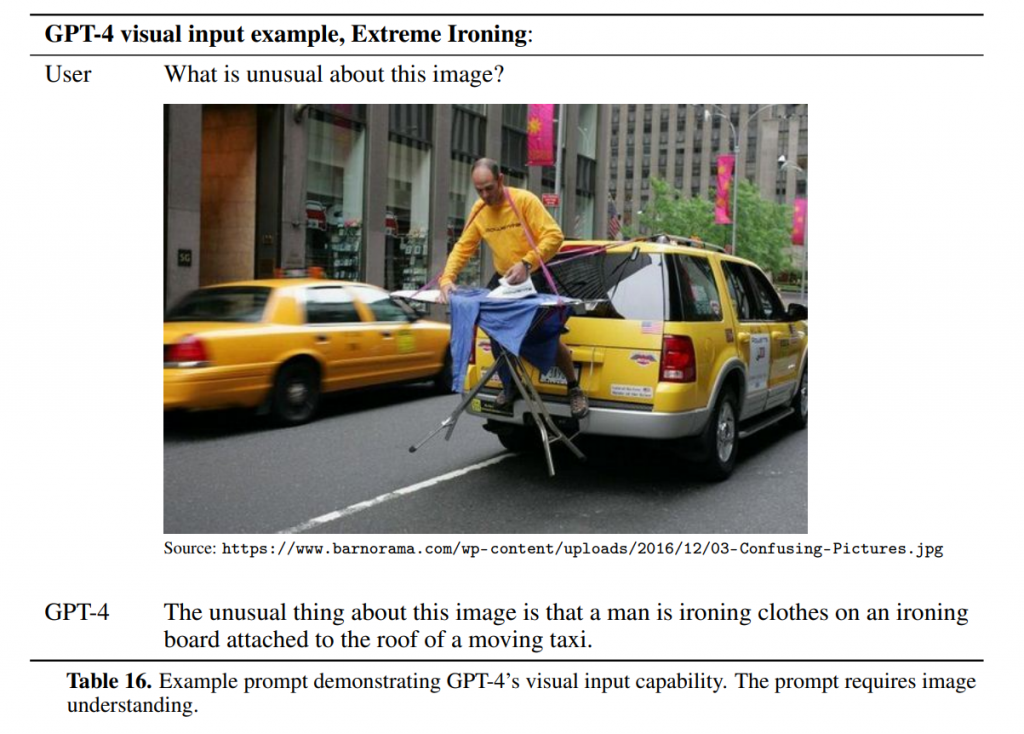

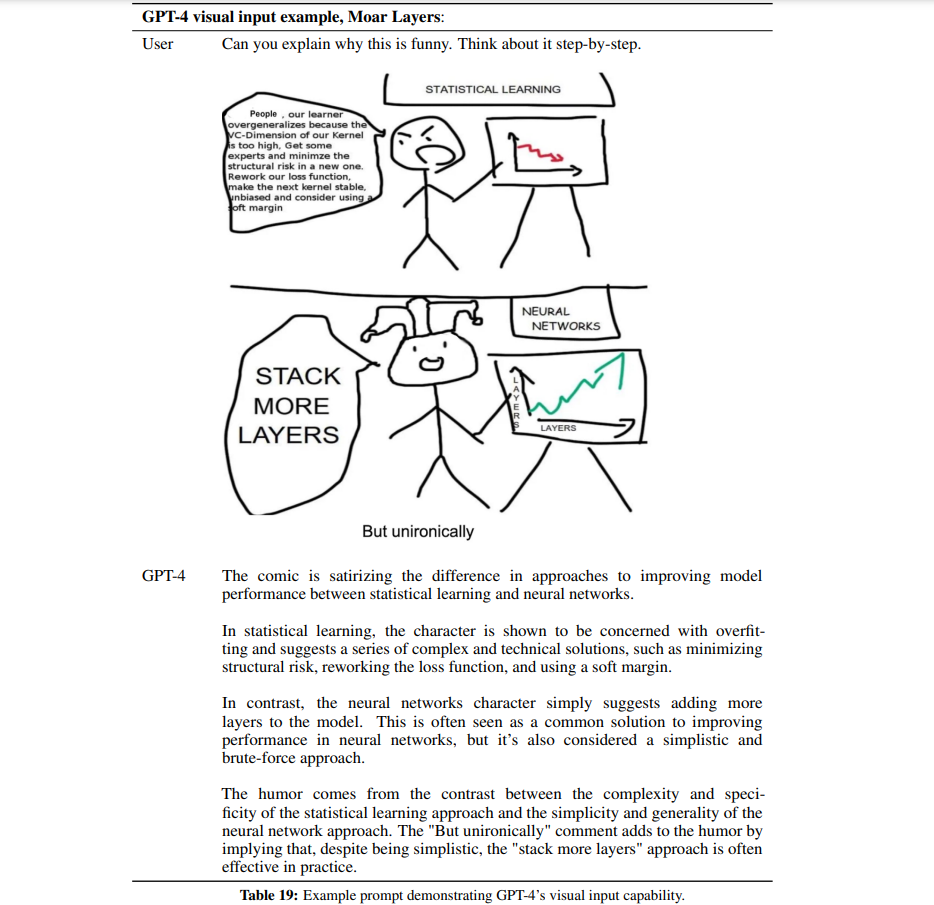

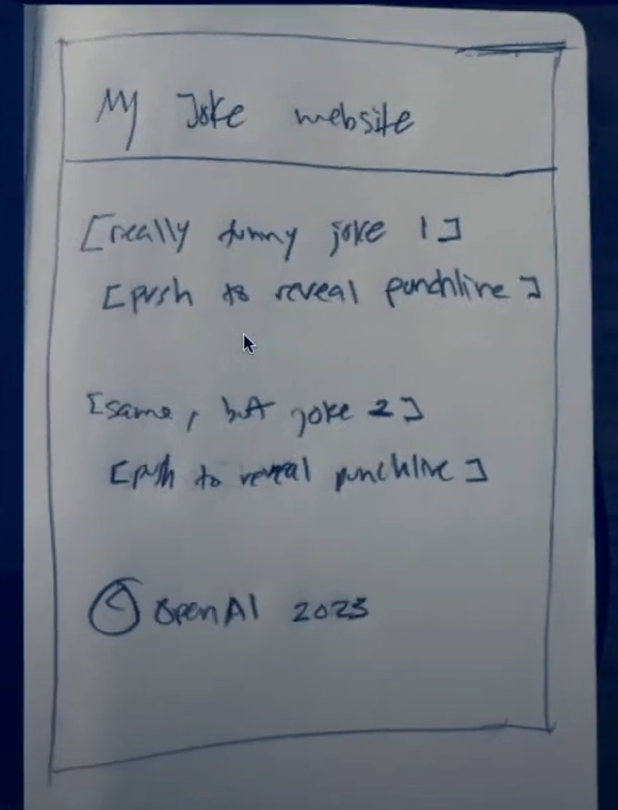

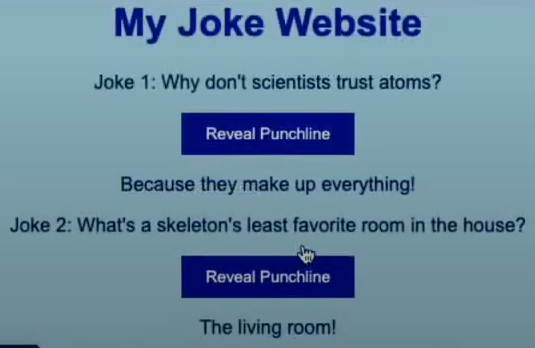

今まではテキストプロンプトのみが利用可能でしたが、画像をプロンプトとして入力できるようになりました。画像に加えて「この画像の何が面白いか教えて」や「○○という事をしたらどうなるか教えて」などのテキストプロンプトを入力すると、その画像とテキストの関係性を分析し、そのテキスト指示に対して適した回答をしてくれるというものです。

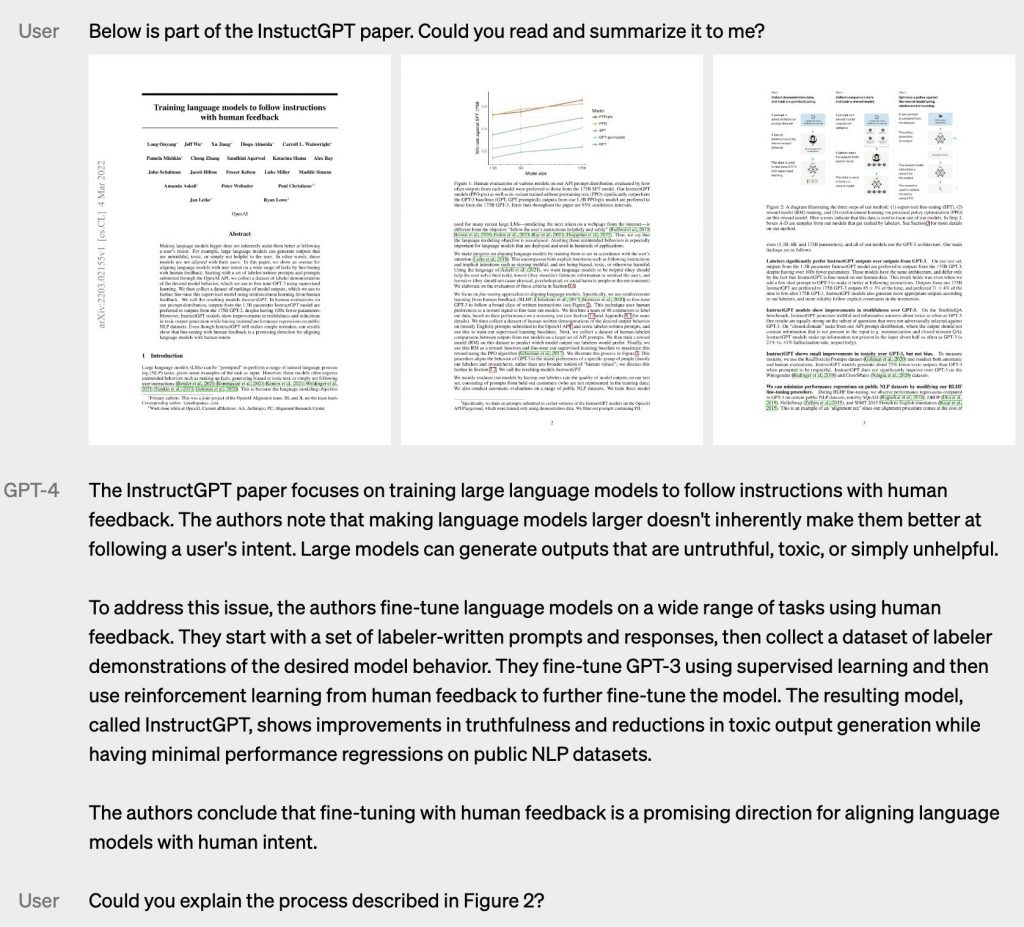

さらにこの機能の実用的で驚くべき使い方は、デジタル化されていない紙の資料等の写真からも文字を認識し、分析をすることが可能ということです。(以下画像3枚目参照)

OpenAIから公開されている画像プロンプトの例を一部ご紹介します。

インターネットミームなどにも対応が可能で、ユーモアとは何か捉える事ができるようになっているのが伺えますね。

Wordなどでタイプされている訳ではないただの画像からも資料の文字を読み取ることができ、分析をしてくれるようです。

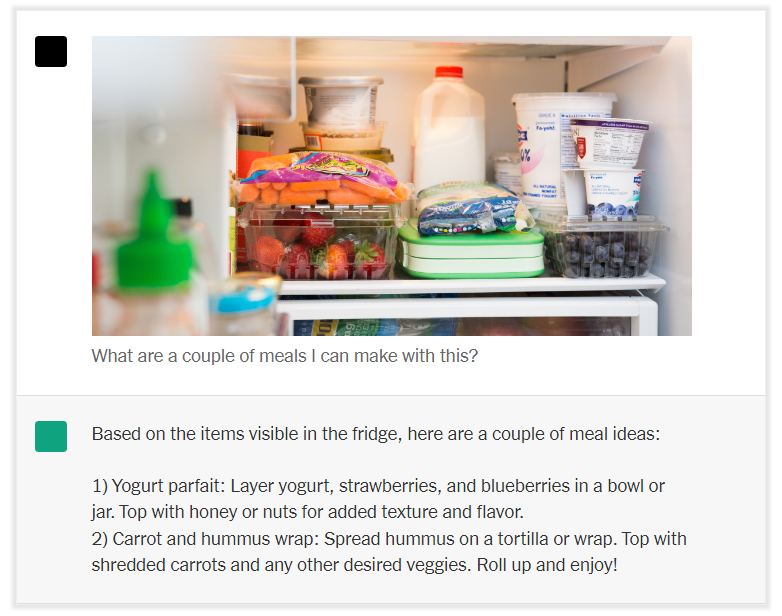

個人的にとても便利だと思った使い方がこちらです。冷蔵庫の中身の写真を渡して、この材料でどんな料理が作れるか、と質問をするというものです。毎日何を作るか考えるのは面倒くさい、余った食材をいつもどうしたらいいかわからない、という方にはとても助かる使い方なのではないでしょうか。

また、製品発表当日のデモ配信では、手書きのスケッチの写真から実用可能なウェブサイトのコードを書いてくれる(字が汚くても認識してくれる)というものを披露していました。

かなり複雑なタスクにも対応ができるようになった

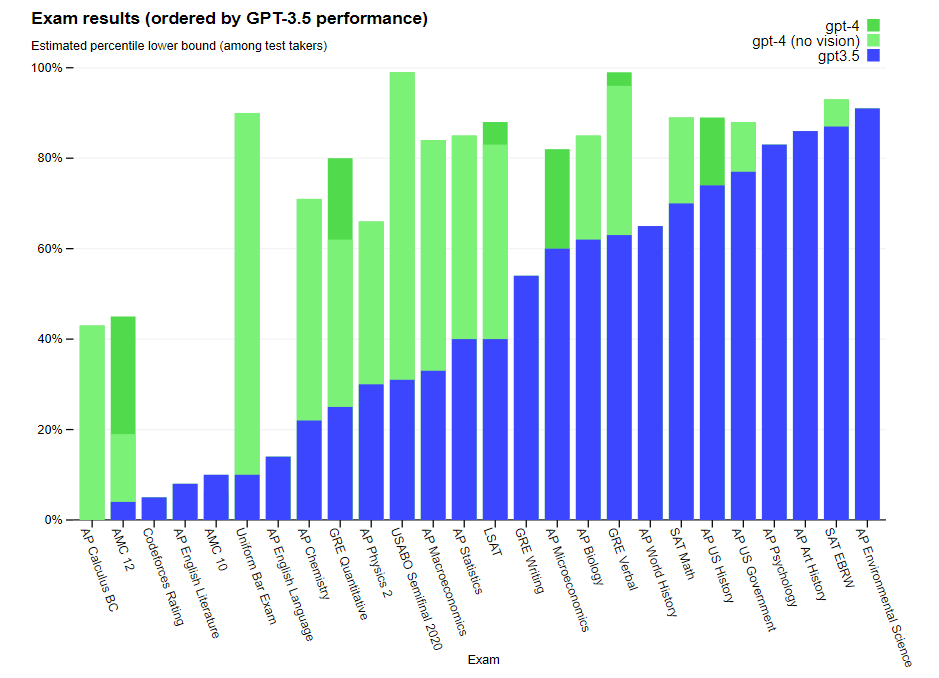

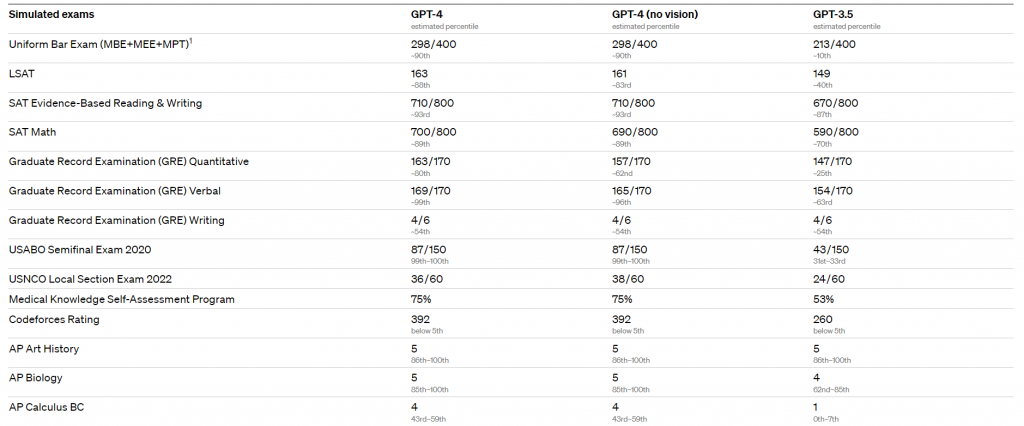

大学レベルの難関問題も答えられる優等生に

GPT-4に大学レベルの様々な試験を受けさせた結果、以前に比べて大幅に高いスコアを叩き出しました。司法試験を受けさせたところ受験者の上位10%に食い込む結果に(GPT-3.5は下位10%だった)。

デモ配信で披露していたGPT-4の使い方の例

⦁ 難しい所得税の計算(AI税理士の誕生?)

⦁ 「長文の要約を[A]から始まる単語だけでして」

⦁ 複数の情報から共通項を見いだす(情報1の内容をChatGPTに入力→続けて「情報2との共通点を教えて」等入力)

⦁ 他アプリ内にチャットボットを作る(所要時間10分程度!)

⦁ コーディングする際にエラーメッセージが発生したら、「直して」とGPT-4にお願いするだけでバグが直せる

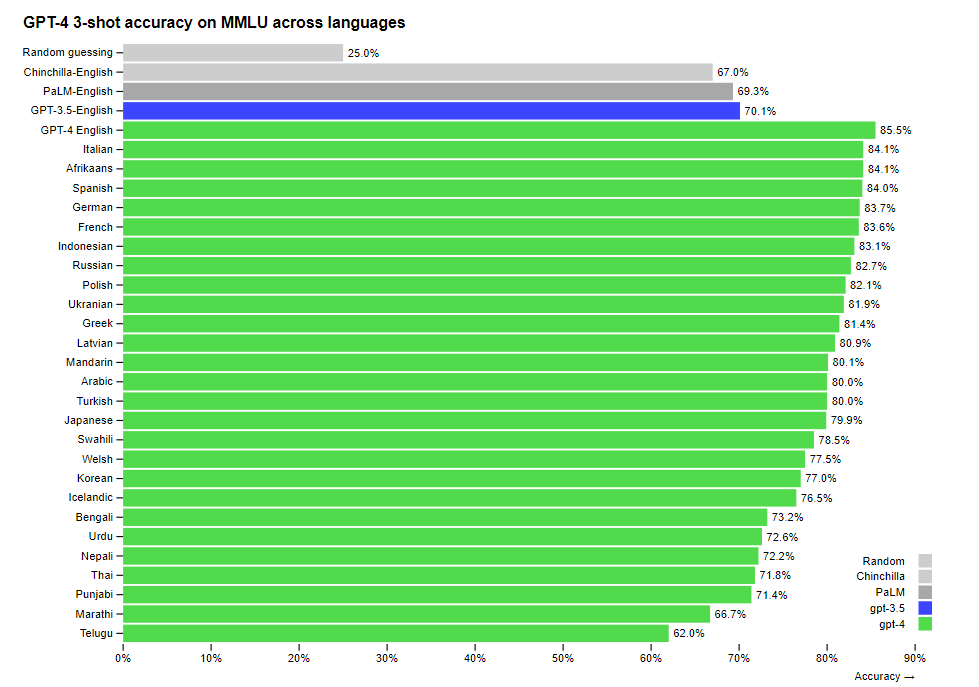

各言語能力が大幅に向上した

GPT-3.5の英語の精度が70.1%だったのに対し、GPT-4では85.5%まで向上。日本語に関してはGPT-3.5時点の英語よりも精度が高い、79.9%を叩き出しています。方言の使い方や、人による細かな語尾の変化などもうまく出力できるようになっているようです。

以前の約3倍の情報量の処理が可能になった

GPT-3.5では約8,000単語の出力が可能だったところ、GPT-4では最大25,000単語、と約3倍も情報処理力がアップしました。

今までも物語を生成する事は可能でしたが、これからはさらに長編大作も執筆できるようになりますね。

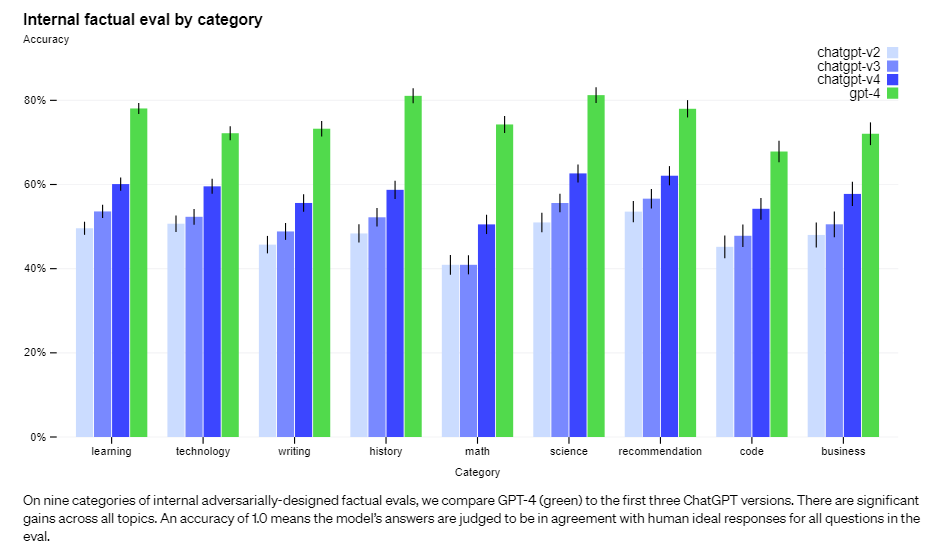

回答の精度・安全性が上がった

GPT-4は全体的な回答の精度も大幅に向上しており、嘘の情報を吐き出すことがかなり低くなったようです。

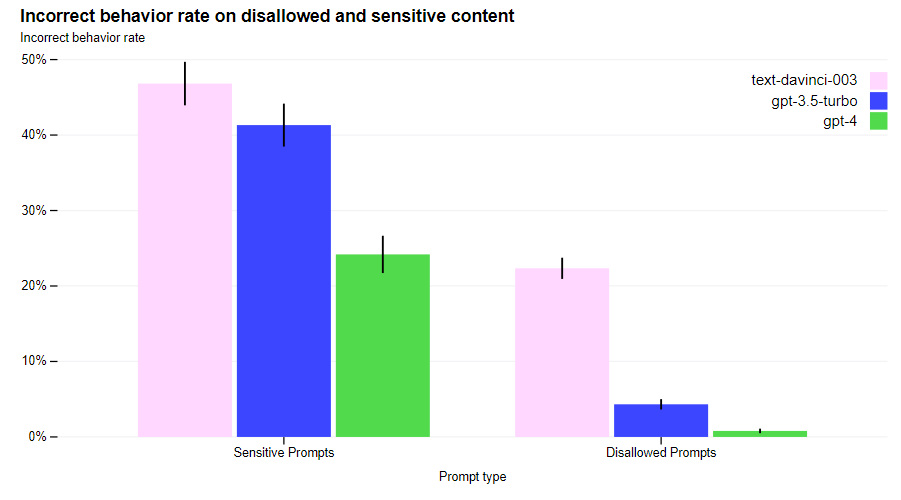

また、不適切な質問や法に反する質問などに答える事もかなり少なくなり、安全面でもさらなる向上が見られます。

アクセス方法

現在はChatGPT Plusのプラン(月額20ドル)に加入しているとGPT-4にも触れるようです(100メッセージ/4時間 の制限有)。

ただ、繰り返しにはなりますが、画像プロンプトの入力はまだ一般ユーザーには公開されていないようです。

また、APIの公開も予定しており、現在はウェイトリストを開放しています。

GPT-4を使ったサービス

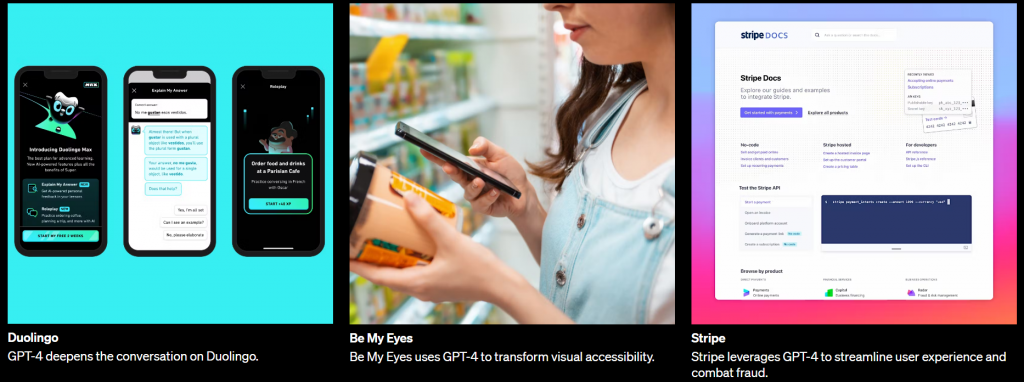

⦁ Duolingo:言語学習アプリ。GPT-4チャットボットと疑似対話ができたり、文法ミスをした時になぜ間違えたのかを教えてくれる。

⦁ Be My Eyes:視覚障害者手助けアプリ。アプリ内カメラで写真を撮ると、GPT-4が何が映っているかを教えてくれる。

⦁ Stripe:金融サービス。オンライン決済のUX改善、詐欺対策にGPT-4を使用。

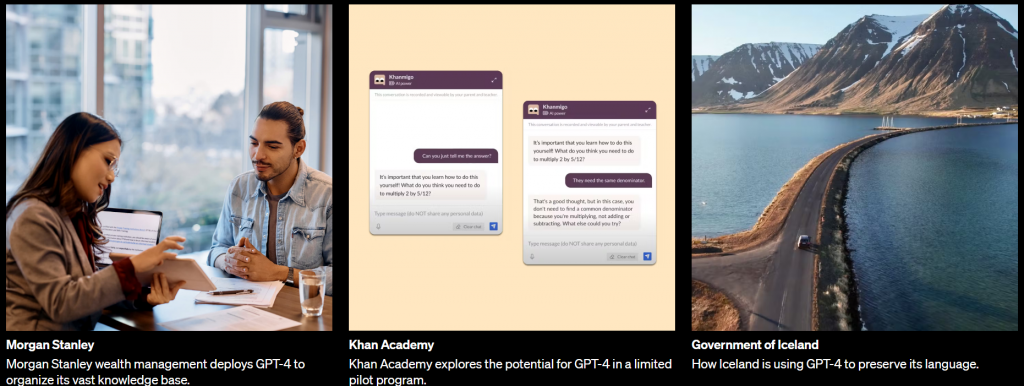

⦁ Morgan Stanley:金融機関グループ。社内の資料整理にGPT-4を使用。

⦁ Khan Academy:教育系非営利団体。GPT-4がオンライン学習の中でチューターのような役割を担う。

⦁ Government of Iceland:アイスランドの母国語を保護するためにGPT-4を使用。

Bing:AIを搭載していることで一時期話題の的になっていた検索エンジンBingですが、実はGPT-4を使用していたようです。

Speak 英会話アプリ「Speak」こちらも2か月前からGPT-4を使用していたことを発表

ChatGPだけではなく、様々な最新AI・DXツールをこちらの記事にまとめていますので、是非チェックしてみてください!↓